Viralne fotke za koje se ispostavilo da su lažne: Kako prepoznati sadržaj kreiran od strane veštačke inteligencije

Komentari

01/05/2023

-19:38

Postoji nekoliko načina da se identifikuje sadržaj kojim je manipulisano, a obraćanje pažnje na detalje je ključno. Stalna poplava informacija na društvenim mrežama često otežava razlučivanje šta je istina, a šta nije, a još više sa nedavnim procvatom veštačke inteligencije (AI).

Novi alati veštačke inteligencije kao što su DALL-E i Midjourney omogućili su praktično svakome da sa lakoćom kreira imaginarne, a ipak verodostojne scenarije. Ovaj trend je doveo do takozvanih dipfejksa (deepfakes): video-snimaka ili slika koje ubedljivo smeštaju određenu osobu u lažan scenario. Uticaj ove tehnologije varira, od šaljivog i glupog, do političkog klevetanja i seksualnog sadržaja bez pristanka.

U trenucima kada se čak i vizuelni prikazi mogu tako lako lažirati, a da su uznemirujuće realistični, ključno je znati kako da uočite manipulisani sadržaj kako biste izbegli dezinformacije i propagandu.

Obratite pažnju na detalje

Važno je uvek analizirati detalje na slikama i paziti na odstupanja kada nešto nije u redu.

Na manipulisanim fotografijama obično nedostaju realistični prikazi osvetljenja, a ruke subjekta su takođe u većini slučajeva digitalno oštećene. Dakle, ako nešto više liči na sliku nego na pravu fotografiju, onda je verovatno lažna.

Na primer, Donald Tramp je nedavno podelio svoju sliku na kojoj se vidi kako kleči ispred reflektora koji je uperen direktno u njega. Međutim, pažljivijim pogledom na sliku vidi da je AI generator pobrkao u kom položaju treba da budu prsti sklopljeni u molitvi. Štaviše, na desnoj mu nedostaje prst, a palčevi su izobličeni.

Pozadina je još jedan detalj na koji treba obratiti pažnju: ne izgleda baš realno da bivši predsednik bude u prostoriji osvetljen reflektorom, a da niko na to ne obraća pažnju.

Neprirodne ili zamućene karakteristike

Drugi primeri lažnih fotografija koje su nedavno postale viralne bile su slike koje lažno prikazuju Trampovo hapšenje - bivši američki predsednik je u aprilu optužen za tajne isplate novca dvema ženama koje su rekle da su sa njim imale seksualne odnose. Tu je i nezaboravna (ali lažna) fotografija Pape u beloj jakni.

Na lažnim slikama Trampovog hapšenja, lica ljudi u okolini često imaju neprirodne tonove kože i voštane ili zamućene crte lica, što su jake indikacije da je u pitanju veštačka realnost.

Kada karakteristike nisu jasne, pažljiviji pogled na samu sliku može otkriti više detalja.

Na primer, na slici pape koju je generisala veštačka inteligencija naočare su deformisane i izgleda da mu ne pristaju kako treba.

Takođe, brzim pogled na njegovu desnu ruku vidimo da boca vode koju drži ima čudan oblik zbog kojeg izgleda kao da se istopila.

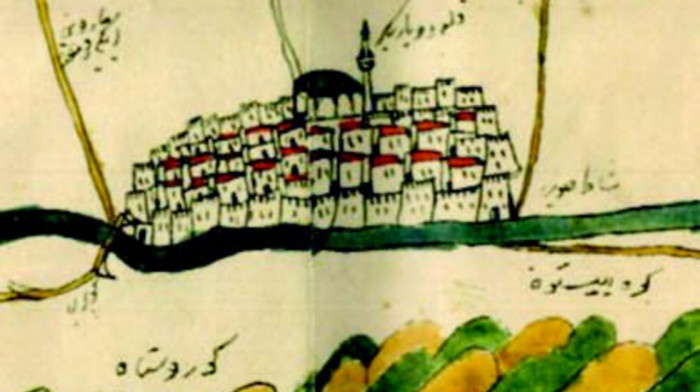

Čudna pozadina

Drugi način da se utvrdi kada je slika generisana veštačkom inteligencijom mogu biti detalji u pozadini slike. Na primer, na slici koja prikazuje francuskog predsednika Emanuela Makrona kako skuplja smeće tokom vrhunca štrajkova protiv penzione reforme u Francuskoj, neodgonetljivi natpisi na kesama za otpake su najbolji dokaz (osim nadrealizma situacije), da je slika lažna.

Ljudi koji žive u Francuskoj takođe mogu primetiti da pešački semafor u pozadini ne liči na onaj koji biste inače videli u Parizu ili bilo kom drugom francuskom gradu.

Iskrivljene ruke i pravopis

Veštačka inteligencija se i dalje bori da pravilno napiše reči. Na lažnoj slici hapšenja Makrona, reč "policija" na šlemovima i uniformama policajaca nije ispravno napisana - a Makronova desna ruka ima šest prstiju.

Uočavanje dipfejk video zapisa

Iako postoje različiti načini na koje se mogu uočiti lažne slike, lažni snimci imaju tendenciju da dele dve glavne osobine: neprirodne pokrete očiju i zvuk koji često nije sinhronizovan sa pokretima usta subjekta u videu.

U video-snimku iz 2019. godine na kojem se vidi kako Donald Tramp osuđuje postupak opoziva pre nego što naglo utvrdi da Džefri Epstajn nije sebi oduzeo život, jasno možemo videti da njegovi pokreti usta ne odgovaraju onome što čujemo.

Dipfejk video snimci su takođe korišćeni za širenje propagande u vezi sa ratom u Ukrajini.

U jednom slučaju, lažni snimak koji navodno prikazuje ukrjainskog predsednika Volodimira Zelenskog koji poziva građane da se predaju Rusiji bio je široko rasprostranjen na društvenim mrežama, a čak je nakratko prenet i na hakovanom ukrajinskom informativnom portalu. Otkriveno je da je video manipulisan budući da takođe sadrži neprirodne pokrete očiju.

Međutim, kako tehnologija veštačke inteligencije bude napredovala, teže će biti otkriti neslaganja između stvarnog i lažnog sadržaja na internetu. Iz toga razloga, najvažniji način da se otkriju dipfejk snimci i izbegnu dezinformacije jeste provera činjenica i dovođenje u pitanje pouzdanosti izvora koji dele slike ili video zapise.

Važno je dobiti informacije od zvaničnih i pouzdanih izvora kao što su zvanične vladine agencije ili kredibilne novinske platforme. U većini slučajeva, dovoljna je brza pretraga na internetu, koristeći pouzdane izvore vesti ili organizacije za proveru činjenica, kao što su FullFact ili PolitiFact, može pomoći u tome da se utvrdi da li je nešto istina ili nije.

Komentari (0)