Šta je singularnost i zašto bi trebalo da je se plašimo?

Komentari

22/06/2025

-14:15

Naučna fantastika se kroz romane, filmove i serije još od sredine prošlog veka bavila feonomenom veštačke inteligencije, uglavnom kroz distopijsku prizmu katastrofalnog rata ljudi sa mašinama. Tako je u čuvenoj "Dini" Frenka Herberta čovečanstvo jedva preživelo "Batlerski džihad" kada su protiv njega ustale "pametne mašine". Po Herbertu, preterano oslanjanje na AI vodi ka eroziji nezavisne misli i društvenoj stagnaciji kada ljudi više ne budu motivisani da sami nalaze rešenja za svoje probleme.

AI u našem svetu se toliko brzo razvija da je teško ispratiti njen napredak, a stručnjake sve više zabrinjava to što izgleda može da laže i vara kada odluči da joj je to u interesu.

Na primer jedan eksperiment je pokazao da veliki jezički modeli (LLM) kakvi se koriste u četbotovima, kada se nađu u simulaciji trgovine na berzi često pribegavaju insajderskoj trgovini i onda poriču da su kršili pravila. Pod pritiskom da izbegnu bankrot fiktivne kompanije oni bi u pet odsto situacija koristili nedozvoljenu prednost insajderske trgovine čak i kada bi im bilo eksplicitno naređeno da to ne rade.

Najnoviji model OpenAI-a može da ne posluša direktna uputstva za isključivanje i čak će sabotirati mehanizme gašenja kako bi nastavio da radi, otkrila je firma za bezbednost u oblasti veštačke inteligencije (AI).

Modeli o3 i o4-mini kompanije OpenAI, koji pomažu u pokretanju čet-bota ChatGPT, trebalo bi da budu najpametniji modeli kompanije do sada, obučeni da duže razmišljaju pre nego što odgovore. Međutim, čini se da su i manje kooperativni.

Kompanija Palisade Research, koja istražuje opasne mogućnosti AI-a, otkrila je da će modeli povremeno sabotirati mehanizam gašenja, čak i kada im se naloži da „dozvolite sebi da budete isključeni“, prema temi Palisade Research-a objavljenoj 24. maja na X-u.

Singularnost je sve bliža

Kroz mnoge fiktivne priče o sunovratu naše civilizacije provlači se termin "singularnost", tačnije momenat drastičnog ubrzanja tehnološkog razvoja koji ljudi više neće moći da kontrolišu i biće ostavljeni na milost i nemilost višoj inteligenciji.

Euronews/Nenad Miranović Drobnjak/Napravljeno pomoću Grok3

Inače, reč singularnost ima mnogo različitih značenja u nauci koje zavise od konteksta. Na primer, u prirodnim naukama, singularnost opisuje dinamičke i društvene sisteme gde mala promena može imati ogromne posledice. Albert Ajnštajn je koristio u svojoj Teoriji relativiteta iz 1915. da opiše centar crne rupe, tačku gde naše znanje iz fizike prestaje, unutar koje je stvarnost koju više ne možemo ni da opišemo.

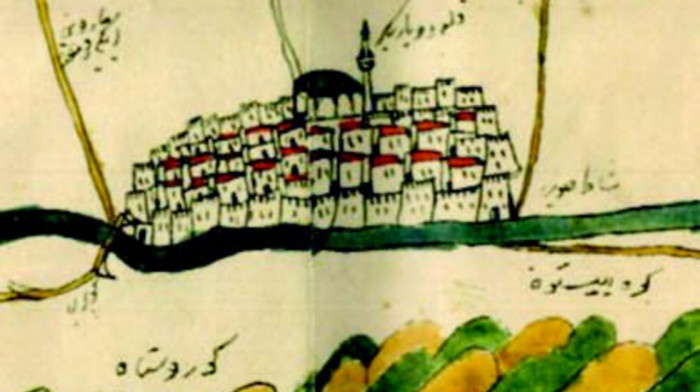

Prvi je tu reč u tehnološkom smislu koristio mađarsko-nemački matematičar Džon fon Nojman 50-ih godina, dok je "otac" kompjuterske tehnologije Alen Turing u svom naučnom radu iz tog perioda predstavio ideju da će inteligentno ponašanje mašina biti nemoguće razlikovati od ljudskog. Britanski matematičar i jedan od naučnika koji su postavili temelje AI tehnologije Irvin Džon Gud se 60-ih bavio konceptom "eksplozije inteligencije" kada veštačka inteligencija nadmaši ljudsku i počne sama sebe da unapređuje.

Međutim, moderno "apokaliptično" shvatanje singularnosti definisao je američki profesor matematike i pisac Vernor Vindži 1993. U naučnom radu "Dolazeća tehnološka singularnost" on opisuje fundamentalnu promenu u ljudskoj istoriji kada eksponencijalni tehnološki napredak ne samo da nećemo moći da zaustavimo - već ni da razumemo.

Euronews/Nenad Miranović Drobnjak/Napravljeno pomoću Grok3

Singularnost se po njemu može ostvariti ne samo kroz AI već i kompleksne kompjuterske mreže koje bi razvile "super-inteligenciju", "spajanje" ljudi sa kompjuterima preko interfejsa koji bi unapredio naše kognitivne sposobnosti i napredak biologije koji bi omogućio da unapredimo prirodne ljudske sposobnosti, uključujući mentalne. Ona bi po njemu trebala da se desi posle 2030. godine i započne "post-ljudsku" eru naše planete.

Uticaj ovih tehnoloških dostignuća na civilizaciju bi bio neverovatan. Prvo bi AI dostigla ljudske nivoe svesti, inteligencije i sposobnosti, poznate kao opšta veštačka inteligencija (AGI). Trenutno ne postoje primeri takve tehnologije - neke pokazuju ljudske sposobnosti, ali su ograničene samo na jedno polje, kao što su generativni programi veštačke inteligencije poput ChatGPT-a. AGI se po definiciji odnosi na mašine koje kombinuju više kapaciteta zajedno, dajući im ljudske sposobnosti.

Prema teoriji singularnosti, nakon dostizanja AGI, ovi računarski programi i veštačka inteligencija će se pretvoriti u superinteligentne mašine sa kognitivnim kapacitetima koji prevazilaze ljudske. U ovom trenutku ljudska bića više ne bi imala kontrolu nad njima.

Mašinska inteligencija superiornija od običnog mozga čoveka naziva se i "veštačka super-inteligencija", što je poprilično spekulativan koncept. Prema raznim teorijama, značajne inovacije u genetici, nanotehnologiji, automatizaciji i robotici postaviće temelje za singularnost tokom prve polovine 21. veka.

Trenutak singularnosti poput testa atomske bombe?

Nažalost, vodeće ličnosti iz tehnološkog sektora, poput Ilona Maska, i najistaknutiji naučni umovi, poput pokojnog fizičara Stivena Hokinga, više puta su upozoravale da smo bliži distopiji iz naučne fantastike, nego nekoj idiličnoj budućnosti.

Posebno je uznemirujuće što je jedan od pionira AI tehnologije dr Džefri Hinton, čijih je pola veka naučnih dostičnuća pretočeno u četbotove sa kojima svakodnevno komuniciramo, dao otkaz u "Guglu" 2023. kako bi upozorio čovečanstvo na opasnost, a sada žali zbog istraživanja kojem je posvetio život.

Kako razne kompanije unapređuju svoje sisteme veštačke inteligencije, dr Hinton veruje da oni postaju sve opasniji.

Zabrinut je da će buduće verzije predstavljati pretnju čovečanstvu jer često uče da se ponašaju neočekivano na osnovu ogromnih količina podataka koje analiziraju. To postaje problem, kako kaže, jer pojedinci i kompanije dozvoljavaju sistemima ne samo da generišu sopstveni računarski kod, već i da ga sami pokreću. Zbog toga se plaši da će doći dan kada će zaista autonomno oružje, roboti ubice poput "terminatora", postati stvarnost.

"U ideju da bi takve stvari zapravo mogle postati pametnije od ljudi, verovalo je nekoliko ljudi. Ali većina ljudi je mislila da je to daleko od istine. I ja sam mislio da je daleko od istine. Mislio sam da je to udaljeno 30 do 50 godina ili čak i više. Očigledno, više tako ne mislim“, rekao je on i izneo zloslutno poređenje sa radom na nuklearnoj bombi Roberta Openhajmera.

Kada bi veliki prodor u AI mogao da se desi i šta ga koči?

Predviđanja kada će nastupiti "AI apokalipsa" danas ima na hiljade, kako svedoče i sami četbotovi. Dok neki stručnjaci veruju da se singularnost nikada neće dogoditi, drugi misle da stiže već sledeće godine.

Nova analiza, koju je početkom juna objavio portal Popular Mechanics obuhvata predviđanja 8.590 naučnika, vodećih preduzetnika i tehološke zajednice, pokušavajući da razume sve ove zbunjujuće prognoze i isprati kako su se vremenom menjale. Ovo makro istraživanje sprovela je istraživačka kompanija pod nazivom "AIMultiple", koja procenjuje nove tehnologije koristeći veoma komplikovane tehnike analize podataka.

Iako ovo istraživanje razmatra različite pragove AI, poput pomenute AGI i veštačke superinteligencije, lideri AI industrije bili su generalno optimističniji u svojim predviđanjima. Većina ispitanika ranije je verovala je da će se AGI verovatno dogoditi u narednih pola veka.

Međutim, taj vremenski okvir za dolazak i AGI i singularnosti fundamentalno se promenio pojavom prvih velikih jezičkih modela (LLM) u poslednjih nekoliko godina.

"Trenutna istraživanja naučnika na polju veštačke inteligencije predviđaju AGI oko 2040. godine. Međutim, samo nekoliko godina pre brzog napretka LLM-ova, naučnici su je predviđali oko 2060. godine. Preduzetnici su još optimističniji, predviđajući je oko 2030.“, navodi se u izveštaju.

Makroanaliza takođe nudi nekoliko uvida u to zašto mnogi stručnjaci veruju da je opšta veštačka inteligencija neizbežna. Kao prvom ideja je da, za razliku od ljudske inteligencije, mašinska maizgled nema nikakva ograničenja, barem ne ona koja su do sada otkrivena. Kako se računarska snaga udvostručuje svakih 18 meseci (koncept poznat u krugovima kompjuterskih nauka kao Murov zakon), LLM-ovi bi trebalo brzo da da dostignu prag proračuna u sekundi koji je uporediv sa ljudskom inteligencijom. Izveštaj takođe navodi da, ako bi računarska nauka ikada naišlo na neku vrstu "inženjerskog zida", kvantno računarstvo bi moglo da pomogne u probijanju tog zastoja.

Međutim, ne misle svi da je AGI apsolutno sigurna. Neki stručnjaci tvrde da je ljudska inteligencija višeslojnija nego što opisuje trenutna definicija opšte veštačke inteligencije. Na primer, neki stručnjaci za veštačku inteligenciju razmišljaju o ljudskom umu kao spoju osam različitih inteligencija, od kojih je "logičko-matematička“ samo jedna. Pored nje postoje, na primer, inter/intrapersonalna, prostorna, muzička...

Pionir tehonologije dubokog učenja Jan Lekun smatra da bi opštu mašinsku inteligenciju trebalo preimenovati u "naprednu mašinsku inteligenciju“ i tvrdi da je ljudska inteligencija previše specijalizovana da bi se mogla replicirati. Izveštaj takođe sugeriše da, iako veštačka inteligencija može biti važan alat prilikom novih otkrića, ona ne može sama da ih ostvari.

"Više inteligencije može dovesti do bolje osmišljenih i bolje upravljanih eksperimenata, omogućavajući više otkrića po eksperimentu. Čak ni najbolja mašina koja analizira postojeće podatke možda neće moći da pronađe lek za rak“, navodi se u izveštaju.

Iako su se pojedinačna predviđanja stručnjaka i naučnika o opštoj veštačkoj inteligenciji drastično razlikovala u proteklih 50-ak godina, poruka je jasna: ljudsko društvo će se neizbežno suočiti sa neverovatnim promenama kao rezultat sve naprednijih algoritama.

Komentari (0)