"Šta će se desiti kada veštačka inteligencija nadmaši ljudsku": Mračne prognoze stručnjaka koji traže pauzu u razvoju AI

Komentari

01/04/2023

-21:02

Gotovo 2.000 istraživača iz sveta tehnologije, među kojima je i Ilon Mask, zatražilo je da laboratorije za istraživanje veštačke inteligencije (AI) pauziraju na neko vreme razvoj svojih najnaprednijih sistema. U otvorenom pismu objavljenom na sajtu organizacije "Budućnost života", navodi se da "AI sistemi sa inteligencijom koja parira ljudskoj, mogu da predstavljaju značajne rizike za društvo i čovečanstvo, kao što su pokazala istraživanja i rekle neke AI laboratorije".

"Kao što je navedeno u široko prihvaćenim 'Asilomar AI principima', napredna AI mogla bi da predstavlja značajnu promenu u istoriji života na Zemlji, i trebalo bi da se planira i da se njome upravlja uz odgovarajuće brige i mere. Nažalost, trenutno se ne dešava taj nivo planiranja i upravljanja", navodi se u pismu.

"U poslednjih nekoliko meseci, AI laboratorije su se upustile u nekontrolisanu trku za razvijanje i upotrebu sve moćnijih digitalnih umova koje niko - pa čak ni njihovi tvorci - ne može da razume, kontroliše, ili predvidi njihovo ponašanje", ističe se u pismu.

Dodaje se da savremeni AI sistemi sada već mogu da se takmiče sa ljudima u izvršavanju opštih zadataka, "pa je zbog toga neophodno da postavimo neka pitanja".

"Da li bi trebalo da dopustimo mašinama da poplave naše informacione sisteme propagandom i neistinom? Da se automatizuju svi poslovi, čak i oni koji nas ispunjavaju? Da razvijamo neljudske umove koji bi eventualno mogli da budu brojniji i pametniji od nas, i da nas zamene? Da rizikujemo da izgubimo kontrolu nad našom civilizacijom?", pitaju se potpisnici pisma.

Šef "OpenAI": Mislim da mi najglasnije pričamo o ovim problemima

Navodi se da bi moćni AI sistemi trebalo da se razvijaju samo onda kada budemo sigurni da će njihov uticaj biti pozitivan, i da ćemo moći da se nosimo sa njihovim rizicima, a ta sigurnost mora biti "opravdana i da se uvećava u skladu sa uticajem sistema".

U otvorenom pismu poziva se na nedavno saopštenje kompanije "OpenAI" u kom, između ostalog, stoji da će "u nekom trenutku, možda biti važno da se dobije nezavisna revizija pre početka treniranja budućih sistema".

"Mislimo da je taj trenutak došao sad, i pozivamo sve AI laboratorije da odmah pauziraju bar na šest meseci treniranje AI sistema moćnijih od GPT-4. Ova pauza bi trebalo da bude javna i da može da se potvrdi, i da uključi sve ključne aktere. Ako ne može brzo da se primeni, vlade bi trebalo da se uključe i postave moratorijum", ističe se u pismu.

Kompanija "OpenAI" je, inače, poznata po svom četbotu napravljenom za treniranje AI sistema, GPT-4 je njihov najnapredniji sistem do sada.

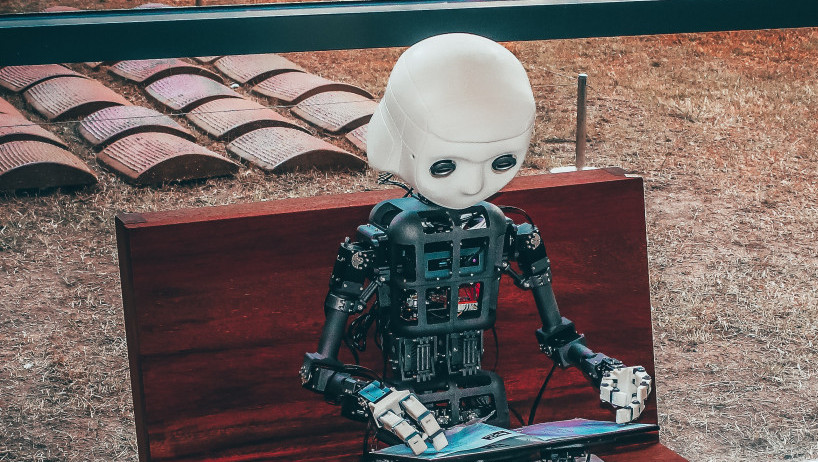

AP/Stephen Brashear

Sem Altman, izvršni direktor "Open AI", ne nalazi se među potpisnicima ovog pisma, a rekao je da ta kompanija već dugo daje prioritet bezbednosti kada je u pitanju razvoj tehnologije, kao i da su "proveli više od šest meseci radeći bezbednosne testove pre nego što je GPT-4 pušten u rad".

"Mislim da smo mi bili najglasniji kada je u pitanju priča o ovim problemima, i da smo o tome govorili najjače i najduže", rekao je Altman, prenosi WSJ.

U petak, 31. marta, valda Italije naložila je momentalnu zabranu prstupa GPT četbotu kompanije "OpenAi", a kao razlog je navedena "zabrinutost za privatnost".

Pored kompanije na čijem čelu se nalazi Altman, ubrzanom razvoju sistema baziranih na veštačkoj inteligenciji su u poslednje vreme pristupile i najveće svetske tehnološke kompanije. Tako je, pored četbota GPT, između ostalih postali popularni i Majkrosoftov četbot Bing, kao i sličan program Gugla, pod nazivom Bard.

Mask: Ako AI pravi automobile, nema svrhe da mi radimo bilo šta

Među potpisnicima je, kao što je već navedeno, Ilon Mask, mada se i njegove kompanije u velikoj meri bave veštačkom inteligencijom. Početkom marta, sam Mask je rekao da smatra kako bi vlada trebalo da reguliše sferu veštačke inteligencije.

"Veštačka inteligencija mi izaziva stres", rekao je on nakon trosatne prezentacije investitorima u "Teslu", njegovu kompaniju za električne automobile. Tom prilikom, dobio je pitanje od jednog AI analitičara o tome da li bi ova tehnologija mogla da pomogne u pravljenju automobila.

"Ne vidim da će nam AI u neko dogledno vreme pomagati u pravljenju automobila. Ako dođe do toga, neće biti svrhe da bilo ko od nas radi", rekao je Mask, prenosi Rojters.

Međutim, nije samo on zabrinut zbog ubrzanog razvoja AI - tu su i mnogi drugi lideri iz sveta nauke i tehnologije.

Na listi onih koji su potpisali otvoreno pismo, nalaze se i Stiv Voznijak, suosnivač "Epla", preduzetnik Endrju Jang, Rejčel Bronson, predsednica Biltena atomskih naučnika koji su odredili "Sat sudnjeg dana", a tu je i pisac i filozof Juval Noa Harari.

"Ove stvari formiraju naš svet. Imamo 'savršenu oluju' koju čine korporativna neodgovornost, široko prihvatanje, manjak regulacije i veliki broj nepoznanica", rekao je za "Njujork tajms" jedan od potpisnika Geri Markus, preduzetnik i akademik koji se već dugo ukazuje na mane AI sistema.

Bendžio: AI sistemi mogu da se koriste na načine koje ne razumemo

Jošua Bendžio, direktor Instituta za algoritme učenja na Univerzitetu u Montrealu i dobitnik Tjuringove nagrade 2018. godine, govorio je nedavno o opasnostima koje nosi ubrzani razvoj AI.

"Dostigli smo tačku u kojoj su ovi sistemi dovoljno pametni da mogu da se koriste na načine koji su opasni po društvo, i na načine koje mi još ne razumemo", rekao je Bendžio u jednom intervjuu.

Na nedavnoj konferenciji za medije, Bendžio se osvrnuo na neophodnost regulacije načina na koji se razvijaju i upotrebljavaju visokorazvijeni AI sistemi.

"Ne možemo da dopustimo da se industrija samoreguliše. Vlade moraju davati neke smernice i nadzirati to. Ono što mi se sviđa kod kanadskog zakonodavstva, jeste što odvaja principe koji su usađeni u zakon, od onih regulacija koje mogu da se prilagode čim se pojave neki problemi".

profimedia

"Ovo je veoma važan element, jer se tehnologija razvija veoma brzo. Usvajanje zakona može da traje dugo, i zavisi od toga kakva je vlada u pitanju, ali zvaničnici mogu brzo da reaguju i da odrede regulative koje bi se prilagođavale situaciji. To je važno, jer ne možemo da predvidimo šta će se dešavati u budućnosti", dodao je Bendžio.

Njegov osvrt na kanadsku regulativu ticao se Zakona C-27 u toj zemlji, koji predstavlja široku regulativu privatnosti i koji je uključio ono će biti prvi kanadski zakon o regulisanju razvoja i primene AI sistema.

Mračne prognoze Jutkovskog

U otvorenom pismu se naglašava da nije u pitanju poziv na razvoj AI uopšte, već samo na "odstupanje od opasne trke za razvojem nepredvidih modela koji nalikuju 'crnim kutijama', a koji imaju sve veće sposobnosti".

"Istraživanje i razvoj AI bi trebalo da se refokusira na pravljenje trenutnih sistema tačnijim, bezbednijim, transparentnijim, interpretativnijim, usklađenijim, lojalnijim, i da se ima više poverenja u njih", navodi se u pismu.

Zbog toga, dodaje se, oni koji rade na razvoju AI pozvani su da rade sa ljudima koji kreiraju zakone, kako bi se "dramatično ubrzao razvoj velikih sistema za upravljanje veštačkom inteligencijom".

Teoretičar AI Elijezer Jutkovski već dugo govori o svojoj zabrinutosti kada je u pitanju upravljanje sistemima baziranim na veštačkoj inteligenciji, a u jednom podkastu prošlog meseca je, čak, rekao i da je "izgubio skoro svu nadu da će čovečanstvo odgovorno postupati sa AI".

On se ne nalazi među potpisnicima otvorenog pisma, ali je u autorskom tekstu za časopis "Tajm", u kom je "pozvao na potpuno gašenje", rekao da bi "šestomesečni moratorijum svakako bio bolji nego da moratorijuma uopšte i nema", i dodao da "poštuje sve koji su potpisali pismo".

Prinstscreen YouTube/Lex Fridman

"Ja nisam potpisao zbog toga što mislim da pismo potcenjuje ozbiljnost situacije, i da se u njemu zahteva premalo kako bi došlo do rešenja", naveo je Jutkovski.

"Ključni problem nije 'inteligencija kompetitivna sa ljudima', kako je navedeno u otvorenom pismu, već šta će se desiti kada AI dođe do inteligencije koja je pametnija od ljudske. Možda ključne crvene linije nisu očigledne, ali definitivno ne možemo da izračunamo unapred šta će biti kada se to desi, a trenutno je zamislivo da istraživačke laboratorije pređu kritične linije a da to i ne primete", dodao je on.

"Mnogi istraživači koji se bave ovim problemom, uključujući i mene, očekuju da bi najverovatniji rezultat stvaranja superljidski pametnog AI, pod bilo kakvim okolnostima makar i izdaleka sličnim ovima danas, bilo to da će svi na Zemlji doslovno umreti. Ne mislim tu da 'postoji neka šansa', već da je 'očigledno da će do toga doći'. U principu, ne radi se o tome da ne možete da preživite stvaranje nečega mnogo pametnijeg od vas, već o tome da su za takvo nešto potrebni preciznost, priprema i novi naučni uvidi, i da se verovatno ne pretpostavljaju AI sistemi napravljeni od ogromnih prostranstava frakcionih brojeva", ističe Jutkovski.

"Bez takve preciznosti i pripreme, najverovatniji ishod je da AI neće raditi ono što mi želimo, niti će ga biti briga za nas ili svesni život generalno. Briga u tom smislu je nešto što bi u principu moglo da se programira u AI, ali mi za to nismo spremni i trenutno ne zanmo kako to da uradimo", nastavlja on.

Kritičari zovu pismo "velikom zbrkom"

Da nisu svi koji se bave istraživanjem veštačke inteligencije saglasni sa ovim otvorenim pismom, pokazuju i pojedine reakcije iz akademske zajednice (osim reakcije Sema Altmana).

Timnit Gebru, koja je jedan o autora akademskog članka na koje se, između ostalih, otvoreno pismo poziva, objavila je na svom Tviter nalogu da njen članak zapravo "upozorava protiv pravljenja ovakvih prenapumpanih tvrdnji o AI", prenela je agencija AP.

"Oni u suštini kažu suprotno od onoga što mi govorimo, i pri tome citiraju naš rad", navela je ona u objavi.

Koautorka ovog naučnog članka pod nazivom "O opasnostima stohastičkih papagaja: Da li jezički modeli mogu biti preveliki", Emili Bender, nazvala je otvoreno pismo "velikom zbrkom".

Rizici koje nosi veštačka inteligencija, navodi Bender, nikada se nisu odnosili na to da ona može postati "previše moćna". Umesto toga, rizici su podrazumevali "koncentraciju moći u ljudskim rukama, pravljenje sistema represije, i štetu informacionom ekosistemu", pojasnila je Bender.

Nik Holiman, naučnik sa Tjuring instituta i Kraljevskog koledža u Londonu, odgovorio je na tvit Gerija Markusa o otvorenom pismu, nazvavši ga "šašavom distrakcijom", rekavši da se zapravo radi na pitanjima poput testiranja AI sistema, uvođenju etičkih i tehničkih standarda, i izračunavanju uticaja po okolinu.

Emad Mostak, jedan od potpisnika otvorenog pisma i šef britanskog startapa "Stability AI", samo nekoliko sati nakon što je pismo objavljeno odstupio je od njegovog centralnog zahteva.

"Ne mislim da je šestomesečna pauza najbolja ideja. Ipak, mislim da se u pismu nalaze neke zanimljive stvari, i da će ono pomoći da se podstakne debata", naveo je Mostak na Tviteru.

"Podsticanje straha i dizanje buke oko veštačke inteligencije"

Ipak, četiri stručnjaka za veštačku inteligenciju izrazila su zabrinutost nakon što je njihov rad citiran u otvorenom pismu, koje je, između ostalih, potpisao Ilon Mask, a u kojem se zahteva da se pod hitno zaustavi istraživanje veštačke inteligencije.

Kritičari su optužili Institut za budućnost života (FLI), neprofitnu organizaciju koja stoji iza pisma, a koju prvenstveno finansira Mask fondacija, da daje prioritet "zamišljenim apokaliptičnim scenarijima" u odnosu na neposrednije brige koje izaziva veštačka inteligencija, kao što su rasističke ili seksističke predrasude koje se programiraju u mašine.

Među navedenim istraživanjima u pismu je "O opasnostima stohastičkih papagaja", rad čiji je koautor Margaret Mičel, koja je prethodno nadgledala etičko istraživanje veštačke inteligencije u Guglu. Mičel, sada glavni etički naučnik u firmi za veštačku inteligenciju "Hugging Face", kritikovala je pismo, rekavši za Rojters da je nejasno šta se smatra "moćnijim od GPT4".

Mičel i njeni koautori Timnit Gebru, Emili M. Bender i Anđelina Mekmilan-Mejdžor, objavili su odgovor na pismo, u kojem su kritikovali njegove autore za "podsticanje straha" i dizanje buke oko veštačke inteligencije.

Predsednik FLI Maks Tegmark rekao je za Rojters da kampanja ne predstavlja pokušaj da se poremeti korporativna prednost OpenAI.

"To je prilično urnebesno. Vidio sam kako ljudi govore: 'Ilon Mask pokušava da uspori konkurenciju'", rekao je Tegmark.

On je naglasio da Mask nije imao nikakvu ulogu u sastavljanju pisma.

Docent na Univerzitetu Konektikat Širi Dori-Hakoen rekla je za Rojters da je saglasna sa nekim delovima pisma, ali je osporila način na koji se njen rad spominje u pismu.

Ona je prošle godine bila koautor istraživačkog rada u kojem se tvrdi da raširena upotreba veštačke inteligencije već predstavlja ozbiljan rizik.

U njenom istraživanju navodi se da današnja upotreba sistema veštačke inteligencije može da utiče na donošenje odluka u vezi s klimatskim promenama, nuklearnim ratom i drugim egzistencijalnim pretnjama.

"Veštačka inteligencija ne mora da dosegne inteligenciju na ljudskom nivou da bi pogoršala te rizike. Postoje neegzistencijalni rizici koji su zaista, zaista važni, ali ne dobijaju istu vrstu pažnje na nivou Holivuda", rekla je ona.

Direktor Centra za bezbednost veštačke inteligencije, sa sedištem u Kaliforniji, Den Hendriks, koji je takođe citiran u pismu, rekao je za Rojters da je razumno razmotriti događaje "crnog labuda", one koji izgledaju malo verovatni, ali bi imali razorne posledice.

Komentari (0)