Veštačka inteligencija već odlučuje o životu i smrti: Pentagon traži "ubojite mašine", tech giganti odbijaju kontrolu

Komentari

12/03/2026

-11:00

Ko može da spreči američko Ministarstvo odbrane (Pentagon) da koristi veštačku inteligenciju (AI) za masovno praćenje građana ili za opremanje autonomnih oružanih sistema koji bi zaobilazili ljudski faktor u donošenju odluka? Odgovor na ovo pitanje, koje sve više opterećuje etičke debate o modernom ratovanju, stigao je od tehnološke kompanije Anthropic, koja je insistirala da ne može da ukloni ove dve "sigurnosne kočnice" iz njihovog dogovora. To je izazvalo žestoku raspravu između dve strane, koja je kulminirala međusobnim tužbama.

Nakon ovog neslaganja, Pentagon se obratio drugoj vodećoj AI kompaniji, OpenAI. I dok je gigant veštačke inteligencije prvobitno objavio da održava iste "crvene linije" koje je postavio Anthropic, izvršni direktor Sem Altman je na kraju priznao da kompanija ne kontroliše način na koji američka vlada koristi njene proizvode.

AI u akciji: Masovni napadi na Iran

SalamPix/ABACA / Abaca Press / Profimedia

Ova konfrontacija između vlade i privatnih kompanija o korišćenju veštačke inteligencije u ratovima nije budući scenario. Veštačka inteligencija se već intenzivno koristi u američkim vojnim operacijama protiv Irana. Američki i izraelski borbeni avioni pogodili su 28. februara više od 1.000 ciljeva u Iranu. Kako navodi Washington Post, za izbor ciljeva "angažovana" je veštačka inteligencija, koja je u realnom vremenu identifikovala ciljeve i određivala im prioritet. Prema izveštaju, američke snage koriste Maven Smart System kompanije Palantir, koji operateru omogućava da odobri do 80 ciljeva na sat, u poređenju sa 30 bez veštačke inteligencije.

Izveštaj Wall Street Journala dopunjuje ove informacije, navodeći da su, u okviru operacije za likvidaciju iranskog vrhovnog vođe Alija Hamneija, izraelske obaveštajne službe godinama pratile hakovane saobraćajne kamere u Teheranu i presretale komunikacije visokih zvaničnika, takođe uz pomoć veštačke inteligencije.

Etičke i pravne dileme

SalamPix/ABACA / Abaca Press / Profimedia

Profesorka političke teorije na Univerzitetu kraljice Meri u Londonu Elke Švarc, ističe da postoji mnogo načina na koje se veštačka inteligencija može koristiti u vojne svrhe – od kojih mnogi postavljaju značajna etička pitanja.

Kako objašnjava, AI se može koristiti za optimizaciju operacija lanca snabdevanja, održavanje vozila i opreme, ili za prevođenje. Takođe se može koristiti za koordinaciju rojeva dronova.

"Stvari postaju mnogo komplikovanije kada počinjemo da sve veći deo taktičkog i strateškog donošenja odluka prebacujemo na veštačku inteligenciju. Za odgovorne u vojnim operacijama, to je upravo cilj. Da se veštačka inteligencija integriše u većinu, ako ne i sve, operacije, uključujući ciklus ciljanja, gde su etički i pravni ulozi posebno visoki, i to je ono što se čini da vidimo u sadašnjem sukobu između SAD i Irana", objašnjava Švarc.

Ko snosi odgovornost?

/ SWNS / SWNS / Profimedia

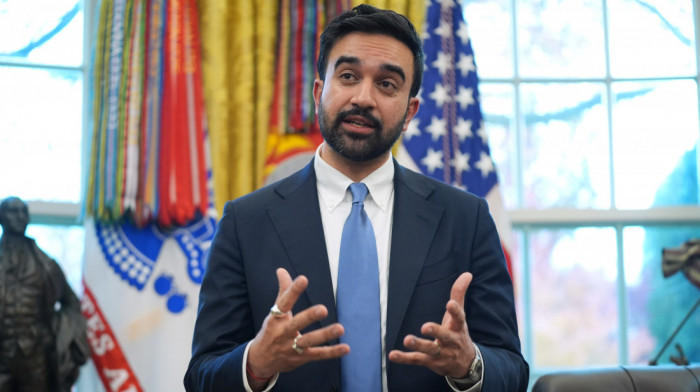

Prema Vasilisu Vasalosu, višem direktoru za AI u kompaniji Automation Anywhere i profesoru informatike na Ekonomskom univerzitetu u Atini, korišćenje veštačke inteligencije na tako važnom nivou donošenja odluka stvara značajne rizike iz dva razloga.

"Prvi je da današnje tehnološke mogućnosti ne obezbeđuju uvek dovoljnu preciznost u proceni stvarne situacije. Nema dovoljno garancija da sistem ispravno razume šta se dešava u ratnom okruženju gde postoji takozvana 'ratna magla' (fog of war). Drugo važno pitanje se tiče odgovornosti za konačnu odluku. Danas ne postoji jasan pravni okvir koji reguliše ko snosi odgovornost u takvim slučajevima", napominje Vasalos, a prenosi Kathimerini.

Na pitanje pouzdanosti AI sistema osvrće se i Jorgos Cojopulos, predavač na Evropskom univerzitetu u Nici i analitičar u ELIAMEP-u, navodeći da tamo gde se ograničava ljudska kontrola, automatski se ograničava i mogućnost verifikacije sistema. S obzirom da sistemi veštačke inteligencije nisu posebno pouzdani, po njegovom mišljenju, u tako nestabilnom međunarodnom okruženju, jedna pogrešna odluka AI sistema mogla bi da dovede do šireg sukoba.

Za Majkla Ričardsona, profesora medija i kulture na Univerzitetu Novog Južnog Velsa, najveći rizik od integracije veštačke inteligencije u vojne operacije je prenošenje odgovornosti za odluke između života i smrti na mašine. Objašnjava da se AI sistemi mogu koristiti za predlaganje ciljeva, a zatim i za odlučivanje da li je smrtonosna akcija opravdana, ili čak za koordinaciju misija i akcija bombardera, projektila i trupa.

"Prebacivanjem odgovornosti na mašine u vezi sa odlukama koje mogu biti smrtonosne, vojske izbegavaju da donose izbore koji se, međutim, zasnivaju na njihovoj etici i deontologiji", objašnjava on.

"Slepo" poverenje

Tanjug/AP/U.S. Central Command

Kako smo došli do toga da govorimo o "slepom" poverenju u veštačku inteligenciju čak i u tako kritičnim pitanjima, poput lokacije bombardovanja? Profesorka Švarc objašnjava da sistemi koji predlažu hiljade ciljeva dnevno, ako ne i na sat, stvaraju, s jedne strane, "pristrasnost automatizacije" (automation bias), tendenciju da odluka mašine postane autoritet, a čovek ima ograničene kognitivne sposobnosti da je preispita. S druge strane, stvaraju i "pristrasnost akcije" (action bias), tendenciju delovanja, gde brzina mehaničke odluke stvara osećaj hitnosti za neposrednu akciju.

"Razmislite o ovome. Ako su SAD ciljale 1.000 ciljeva u prvih 24 sata, to znači otprilike 41 predloženi cilj na sat. To je veoma veliki broj i postaje izuzetno teško proceniti validnost svih tih ciljeva kada su brzina i skala prioritet", primećuje ona, dok Ričardson dodaje da su u Gazi, na primer, novinarske istrage pokazale da su izraelske oružane snage "gotovo uvek bez sumnje sledile preporuke modela veštačke inteligencije za ciljanje".

Stručnjaci i analitičari za AI pitanja smatraju da što se više koristi vojna veštačka inteligencija, to će biti teže utvrditi odgovornost za to kako su informacije stvorene i obrađene, ili zašto je AI sistem proizveo određene rezultate.

"Ako ne bude postojao vrlo strog način ograničavanja ove upotrebe, najverovatniji rezultat je nanošenje više štete. A u ratu uvek civili snose najveći teret nasilja", zaključuje profesorka Švarc.

Komentari (0)